第五期CCF-TF智能媒体计算国际研讨会圆满结束

CCF多媒体专委会 2024-02-05 11:39 山东

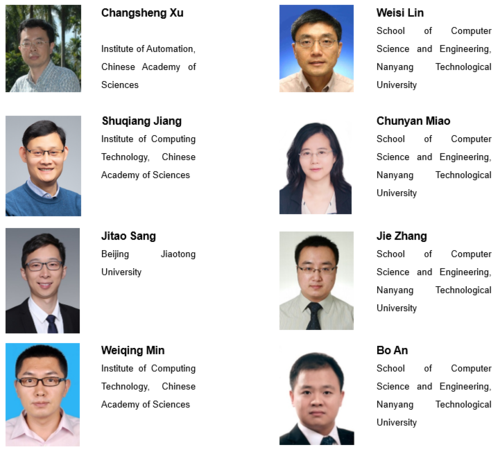

2024年1月25日下午,由中国计算机学会、淡马锡基金会主办,CCF多媒体专委会、南洋理工大学承办的智能媒体计算国际研讨会以线上方式成功举办。本次活动邀请了清华大学弋力博士、浙江大学王文冠博士、北京航空航天大学刘偲教授做特邀报告。中国科学院计算技术研究所蒋树强研究员担任本次活动执行主席。

活动伊始,中国科学院计算技术研究所蒋树强研究员代表CCF多媒体专委会对嘉宾和在线参加活动的老师同学表示欢迎,感谢了此次研讨会的主办方和承办方,接着介绍了三位专家的所属单位,同时表示CCF多媒体专委会很荣幸承办此次智能媒体计算国际研讨会,希望借此研讨会交流前沿技术进展,共同推动多媒体技术的蓬勃发展,最后表达了对本次研讨会的展望和期待。

报告信息

清华大学弋力博士的报告题目是“Empowering Generalizable Human-Robot-Interaction via Human Simulation”。他首先指出了互联网智能向具身智能的演进,并阐述了以人为本的具身智能系统需要深入模拟人类行为和理解人类意图,以便更好地与人类进行交互和协作。由于安全因素,人机协作技能在现实世界中难以进行大规模学习。面对这一挑战,弋博士提出了一种从现实到虚拟再回到现实的学习框架:通过捕获和建模人类日常互动行为的数据,实现对这些行为在虚拟环境中的高精度仿真,然后在虚拟环境中培训机器人执行人机协作任务,并将所学技能转移到现实世界。接着,弋博士介绍了他的团队如何捕捉人类日常活动中的交互行为,并详细说明了构建HOI4D和TACO等数据集的过程。他还展示了他们在数据驱动的人物交互行为仿真领域开展的前沿算法研发工作。以人机交接技能学习为例,他呈现了他们在以人为中心的具身智能学习领域的研究进展。具体而言,弋博士讲述了人机交接技能学习当前面临的挑战,包括扩展用于模拟的物体和人体动作资源、提高机器人示范的规模和效率,以及学习具有普遍适用性的交接技能。他解释了他的团队是如何通过生成式的大规模仿真、基于动态捕捉和运动规划的自动化演示生成以及基于四维视觉的大规模模仿学习来获取泛化的交接技能。最后,他通过实验证明了这些方法的有效性和卓越性能。

浙江大学王文冠博士的报告题目是“Social-Cognitive Embodied AI”。王博士简要介绍了具身智能的研究背景,之后以智能机器的社会化应用为导向,探讨感知智能到交互智能和认知智能的范式转变,强调构建社交-认知具身智能体的重要性,之后,围绕社交-认知具身智体的四个核心要素:感知、推理、规划和交互,介绍其相关研究工作。在感知方面,王博士介绍了神经-逻辑驱动的智能感知模型以及基于BEV环境表征和智能探索机制的主动感知模型。在推理方面,介绍了视觉溯因推理。在规划方面,王博士介绍了基于世界模型的思维规划和面向真实复杂动态任务规划的、大模型驱动的智能体。在交互方面,王博士介绍了人-机语言交互和多通道非语言交互。

北京航空航天大学刘偲教授的报告题目是“Research on Key Technologies of Multimodal Embodied Navigation”。首先,她介绍了具身智能与互联网智能、以及具身智能与旁观者智能之间的区别与联系。接着,她详细介绍了多模态具身导航作为具身智能体获取基本运动决策能力的关键方面,强调了其在研究上的重要性和意义。除此之外,她还介绍了多模态导航的一系列学术工作,包括分层规划、目标预测、知识推理和声音导航等方面。她强调了这些工作在实现多模态导航中的关键技术,为具身智能体提供了更全面的感知和决策能力。最后,她阐述了她的研究工作的总体架构,并对实验结果进行了深入的分析。

研究交流

在每位教授汇报完毕后都有专门的交流环节。有各位青年教师、相关领域研究人员和学生向三位教授提出了学术问题,三位教授基于自己的领域知识解除了他们的疑惑并提供的专业性建议。本次研讨会的交流具有很强的针对性和实用性,青年教师、研究人员和学生都表示受益匪浅。

活动总结

会议采取腾讯会议的方式,腾讯会议参加人数100余人。最后,中国科学院计算技术研究所蒋树强研究员进行了活动总结,首先感谢了三位专家的精彩报告与学术交流分享,同时感谢了线上听众的热情参与和提问,并祝贺本次活动取得了圆满成功。

组织者